Einleitung: Die ethische Dimension der Robotik

Die rasche Entwicklung und zunehmende Integration von Robotern in unseren Alltag wirft fundamentale ethische Fragen auf, die weit über technische Aspekte hinausgehen. Von autonomen Fahrzeugen über Pflegeroboter bis hin zu KI-gesteuerten Entscheidungssystemen – die Robotik verändert nicht nur, wie wir arbeiten und leben, sondern auch, wie wir über Verantwortung, Autonomie und menschliche Werte nachdenken müssen.

Während die technologischen Fortschritte beeindruckend sind, stehen wir vor der Herausforderung, sicherzustellen, dass diese Entwicklungen im Einklang mit ethischen Grundsätzen stehen und zum Wohle der Gesellschaft eingesetzt werden. Dieser Artikel untersucht die wichtigsten ethischen Herausforderungen in der Robotik und diskutiert mögliche Ansätze für einen verantwortungsvollen Umgang mit dieser transformativen Technologie.

Autonomie und Entscheidungsfindung: Wer trägt die Verantwortung?

Mit der zunehmenden Autonomie von Robotersystemen stellt sich die grundlegende Frage nach der Verantwortung für ihre Entscheidungen und Handlungen.

Herausforderungen:

- Das Verantwortungsvakuum: Bei Unfällen oder Fehlentscheidungen autonomer Systeme ist oft unklar, wer die Verantwortung trägt: der Hersteller, der Programmierer, der Nutzer oder das System selbst?

- Komplexität der Entscheidungsfindung: Moderne KI-Systeme wie neuronale Netze treffen Entscheidungen auf Basis komplexer, oft nicht nachvollziehbarer Prozesse, was eine Zuordnung von Verantwortung erschwert.

- Unterschiedliche Rechtssysteme: Weltweit existieren unterschiedliche rechtliche Rahmenbedingungen für die Haftung bei Roboter-verursachten Schäden.

Lösungsansätze:

- Explainable AI (XAI): Die Entwicklung von KI-Systemen, deren Entscheidungsfindung transparent und nachvollziehbar ist, ermöglicht eine bessere Verantwortungszuordnung.

- Ethik by Design: Integration ethischer Überlegungen bereits in der Entwicklungsphase, nicht erst als nachträgliche Korrektur.

- Stufenweise Autonomie: Klar definierte Autonomiegrade mit entsprechender Verantwortungsverteilung zwischen Mensch und Maschine.

- Internationale Standards: Entwicklung globaler Standards für die Haftung bei autonomen Systemen, ähnlich wie bei der Luftfahrt oder der Pharmaindustrie.

Ein vielversprechender Ansatz ist das Konzept der "sinnvollen menschlichen Kontrolle" (meaningful human control), das fordert, dass Menschen trotz zunehmender Automatisierung die letzte Entscheidungsinstanz bleiben müssen, besonders bei kritischen Anwendungen.

Datenschutz und Privatsphäre: Die allgegenwärtige Überwachung

Roboter, insbesondere in häuslichen oder öffentlichen Umgebungen, sammeln kontinuierlich Daten über ihre Umgebung und die Menschen, mit denen sie interagieren.

Herausforderungen:

- Umfassende Datensammlung: Roboter können in Privatbereichen sensible Informationen erfassen, die weit über das hinausgehen, was für ihre Funktion notwendig ist.

- Permanente Überwachung: Im Gegensatz zu anderen digitalen Geräten können Roboter kontinuierlich überwachen und physisch navigieren.

- Datensicherheit: Die gesammelten Daten können kompromittiert oder für nicht autorisierte Zwecke verwendet werden.

- Informierte Einwilligung: Bei Robotern in öffentlichen Räumen ist es oft nicht möglich, die informierte Einwilligung aller betroffenen Personen einzuholen.

Lösungsansätze:

- Privacy by Design: Integration von Datenschutzmaßnahmen in den gesamten Entwicklungsprozess von Robotern.

- Lokale Datenverarbeitung: Wo möglich, sollten Daten lokal auf dem Gerät verarbeitet werden, ohne sie an externe Server zu übermitteln.

- Datenminimierung: Beschränkung der Datenerfassung auf das für die Funktionalität absolut Notwendige.

- Transparente Signalisierung: Klare Hinweise, wenn ein Roboter Daten sammelt (z.B. durch Lichtsignale oder akustische Signale).

- Nutzerfreundliche Kontrolle: Einfache Möglichkeiten für Nutzer, die Datenerfassung einzuschränken oder auszusetzen.

In Europa bietet die Datenschutz-Grundverordnung (DSGVO) bereits einen rechtlichen Rahmen, der auch auf Robotersysteme anwendbar ist. Allerdings sind spezifischere Regelungen für die besonderen Herausforderungen der Robotik notwendig.

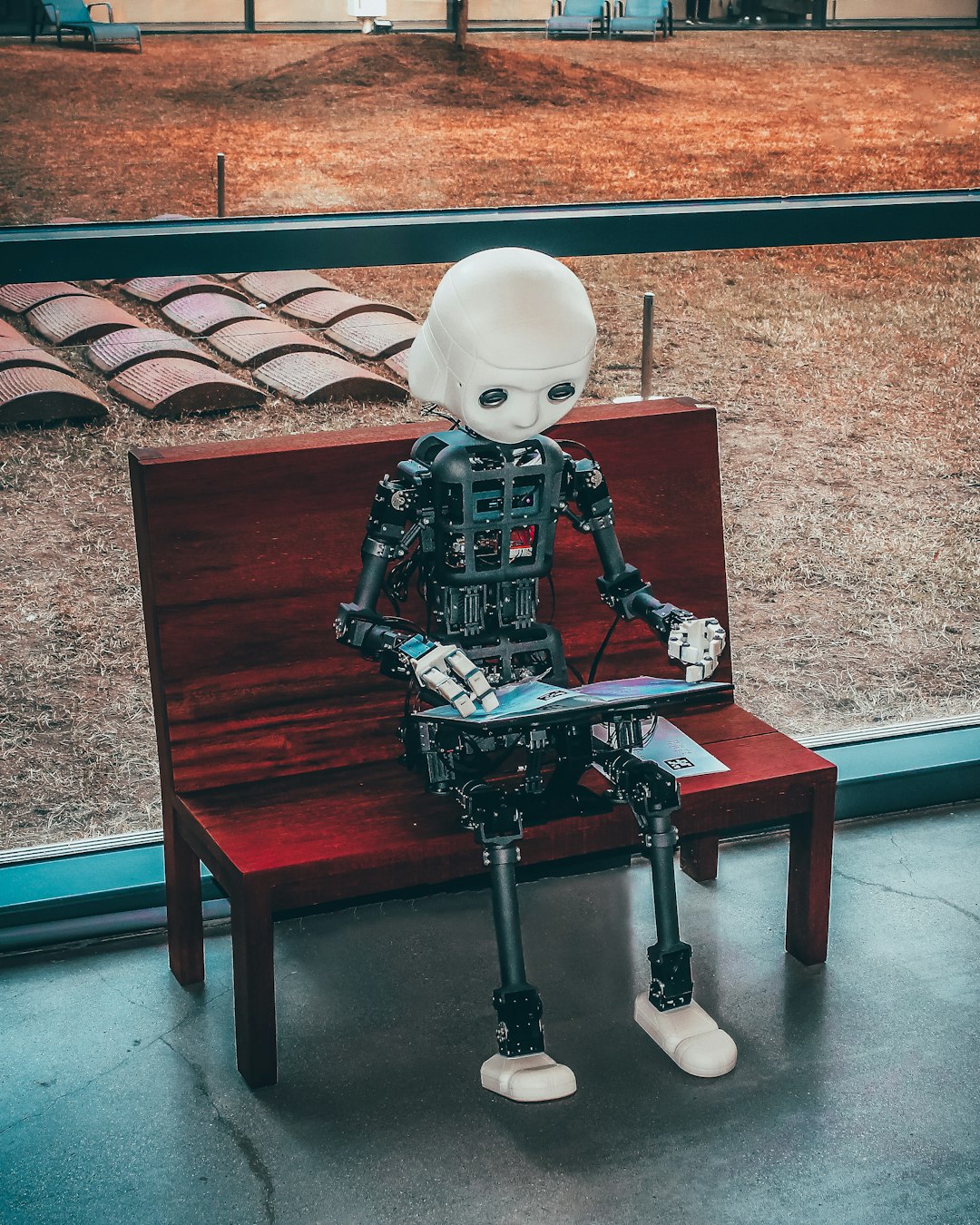

Soziale Auswirkungen: Arbeitsplätze, Ungleichheit und Menschenwürde

Die Robotisierung hat weitreichende gesellschaftliche Implikationen, die ethische Fragen zu Arbeit, sozialer Gerechtigkeit und menschlicher Würde aufwerfen.

Herausforderungen:

- Arbeitsplatzverluste: Automatisierung durch Robotik könnte zu signifikanten Arbeitsplatzverlusten führen, besonders in bestimmten Sektoren.

- Digitale Kluft: Ungleicher Zugang zu robotischer Technologie könnte bestehende soziale und wirtschaftliche Ungleichheiten verstärken.

- Menschliche Würde: Besonders im Pflegebereich stellt sich die Frage, ob der Einsatz von Robotern die menschliche Würde und den sozialen Kontakt gefährdet.

- Abhängigkeit und Autonomieverlust: Übermäßige Abhängigkeit von Robotern könnte zu einem Verlust menschlicher Fähigkeiten und Autonomie führen.

Lösungsansätze:

- Proaktive Bildungspolitik: Umschulung und Weiterbildung von Arbeitnehmern für Berufe, die weniger automatisierbar sind oder die mit Robotern kooperieren.

- Mensch-Roboter-Kollaboration: Förderung von Ansätzen, bei denen Roboter Menschen ergänzen statt ersetzen (Koboter statt vollständiger Automatisierung).

- Universelles Grundeinkommen: Einige Experten schlagen vor, dass die wirtschaftlichen Vorteile der Automatisierung durch ein universelles Grundeinkommen breiter verteilt werden sollten.

- Ethische Richtlinien für spezifische Anwendungen: Besonders in sensiblen Bereichen wie der Pflege sind spezifische ethische Rahmenbedingungen notwendig.

Die Japan Nursing Association hat beispielsweise Richtlinien für den Einsatz von Pflegerobotern entwickelt, die betonen, dass Roboter menschliche Pflege ergänzen, aber nicht ersetzen sollten, und dass der Einsatz von Robotern stets die Würde und Autonomie der Patienten respektieren muss.

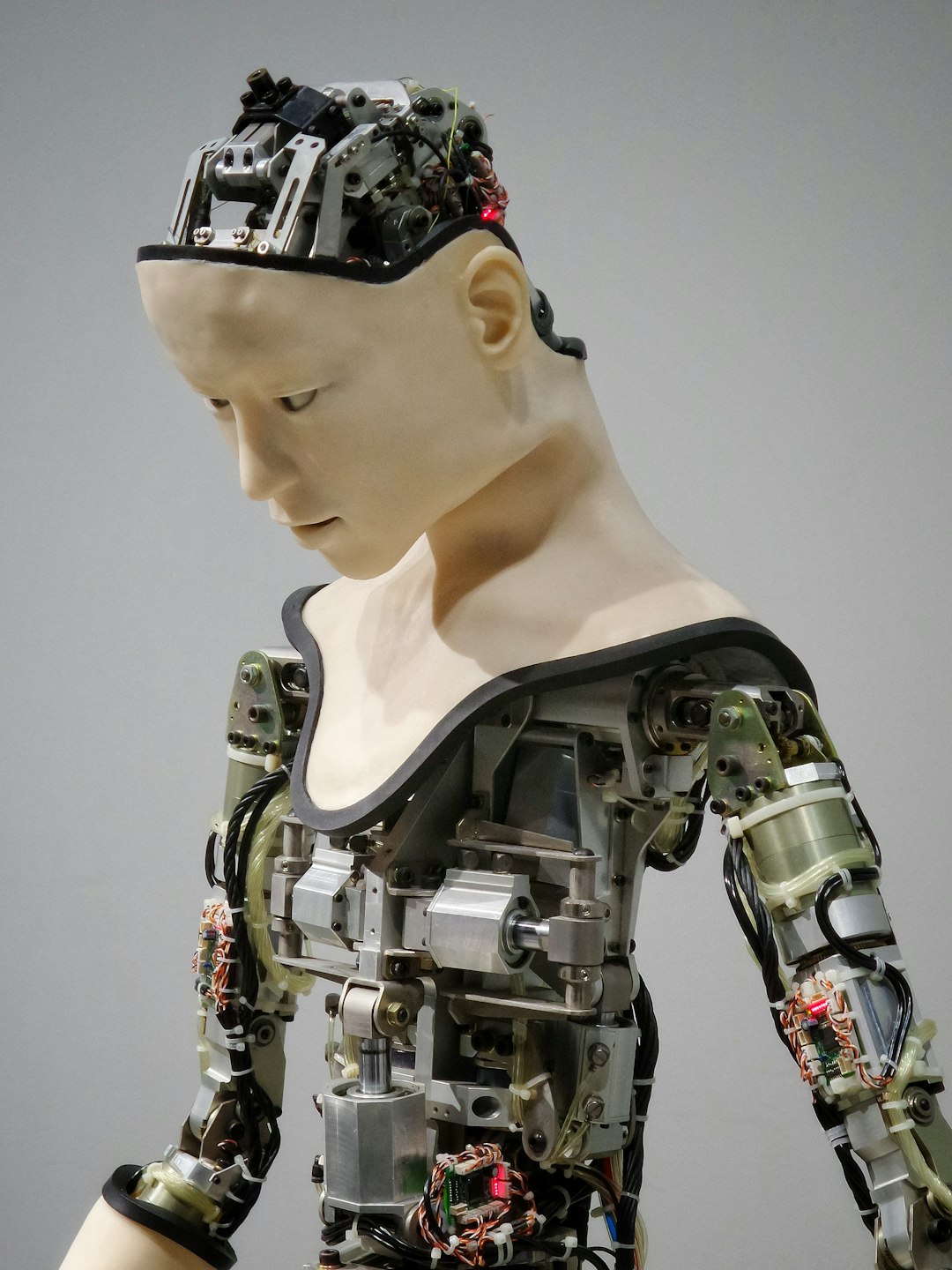

Anthropomorphisierung und emotionale Bindung

Menschen neigen dazu, selbst einfachen Robotern menschliche Eigenschaften zuzuschreiben und emotionale Bindungen zu ihnen aufzubauen.

Herausforderungen:

- Täuschung: Die menschenähnliche Gestaltung von Robotern kann unrealistische Erwartungen bezüglich ihrer Fähigkeiten und "Gefühle" wecken.

- Emotionale Manipulation: Die Fähigkeit von Robotern, Emotionen zu simulieren, könnte zur Manipulation verletzlicher Gruppen wie Kinder oder ältere Menschen genutzt werden.

- Ersatz menschlicher Beziehungen: Bei einigen Nutzergruppen könnten Roboterbeziehungen echte menschliche Beziehungen ersetzen, mit unklaren langfristigen psychologischen Folgen.

- Objektifizierung: Die Interaktion mit sozialen Robotern könnte problematische Verhaltensweisen verstärken, wie etwa respektloses Verhalten, das auf menschliche Beziehungen übertragen werden könnte.

Lösungsansätze:

- Transparenz über die Natur des Roboters: Klare Kommunikation darüber, dass es sich um eine Maschine handelt, nicht um ein fühlendes Wesen.

- Ethische Richtlinien für soziale Roboter: Entwicklung spezifischer Richtlinien für den Einsatz von Robotern in sensiblen sozialen Kontexten.

- Interdisziplinäre Forschung: Verstärkte Zusammenarbeit zwischen Technikern, Psychologen und Ethikern bei der Entwicklung sozialer Roboter.

- Begleitende Bildungsmaßnahmen: Besonders für Kinder sind begleitende Bildungsmaßnahmen wichtig, die den Unterschied zwischen Robotern und Menschen verdeutlichen.

In Japan, wo soziale Roboter besonders verbreitet sind, werden zunehmend Studien durchgeführt, um die langfristigen psychologischen Auswirkungen der Mensch-Roboter-Interaktion zu verstehen und entsprechende Richtlinien zu entwickeln.

Militärische Anwendungen und Dual-Use-Problematik

Viele Robotertechnologien haben sowohl zivile als auch militärische Anwendungsmöglichkeiten, was komplexe ethische Fragen aufwirft.

Herausforderungen:

- Autonome Waffensysteme: Die Entwicklung von Robotern, die eigenständig über den Einsatz tödlicher Gewalt entscheiden könnten, wirft fundamentale ethische und völkerrechtliche Fragen auf.

- Dual-Use-Technologien: Viele für zivile Zwecke entwickelte Robotertechnologien können auch militärisch genutzt werden.

- Rüstungswettläufe: Die Entwicklung militärischer Robotertechnologie könnte zu neuen Rüstungswettläufen führen.

- Verantwortungsdiffusion: Bei autonomen Waffensystemen besteht die Gefahr einer Verantwortungsdiffusion für Entscheidungen über Leben und Tod.

Lösungsansätze:

- Internationale Verträge: Entwicklung internationaler Abkommen zur Regulierung oder zum Verbot vollautonomer Waffensysteme.

- Ethische Richtlinien für Forschung: Klare ethische Richtlinien für Forscher und Ingenieure im Bereich der Robotik.

- "Meaningful Human Control": Gewährleistung einer sinnvollen menschlichen Kontrolle über alle Waffensysteme, die tödliche Gewalt einsetzen können.

- Transparenz in der Forschung: Offene Kommunikation über Forschungsziele und potenzielle Anwendungen, um öffentliche Kontrolle zu ermöglichen.

Die "Campaign to Stop Killer Robots" ist eine internationale Koalition, die sich für ein präventives Verbot vollautonomer Waffen einsetzt und bereits breite Unterstützung von Wissenschaftlern, Ethikern und mehreren Nationen erhalten hat.

Governance-Strukturen und internationale Zusammenarbeit

Die globale Natur der Robotik-Entwicklung erfordert internationale Governance-Strukturen und Zusammenarbeit.

Herausforderungen:

- Unterschiedliche kulturelle und ethische Perspektiven: Verschiedene Gesellschaften haben unterschiedliche Auffassungen von ethischen Fragen in der Robotik.

- Regulatorische Fragmentierung: Unterschiedliche nationale Regelungen können zu regulatorischer Arbitrage und ungleichen Wettbewerbsbedingungen führen.

- Schnelles technologisches Tempo: Die schnelle Entwicklung der Technologie macht es für regulatorische Prozesse schwierig, Schritt zu halten.

- Machtungleichgewichte: Ungleiche Verteilung von technologischem Know-how und Ressourcen zwischen verschiedenen Ländern.

Lösungsansätze:

- Internationale Ethikstandards: Entwicklung globaler ethischer Richtlinien für Robotik, ähnlich wie die UNESCO-Empfehlung zur Ethik der KI.

- Multi-Stakeholder-Governance: Einbeziehung verschiedener Interessengruppen, einschließlich Zivilgesellschaft, Wissenschaft, Industrie und Regierungen.

- Regulatory Sandboxes: Schaffung experimenteller Regulierungsumgebungen, die Innovation ermöglichen und gleichzeitig ethische Standards sicherstellen.

- Kapazitätsaufbau: Unterstützung für Entwicklungsländer beim Aufbau eigener Kapazitäten in der Robotik und bei der Entwicklung angemessener Regelungen.

Der IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems ist ein Beispiel für eine internationale Multi-Stakeholder-Initiative, die ethische Standards und Richtlinien für KI und Robotik entwickelt.

Fazit: Ein ethischer Kompass für die Zukunft der Robotik

Die ethischen Herausforderungen der Robotik sind komplex und vielschichtig, aber keineswegs unlösbar. Sie erfordern einen proaktiven, inklusiven und interdisziplinären Ansatz, der technische Innovation mit ethischer Reflexion verbindet.

Wichtige Grundprinzipien für eine ethisch verantwortungsvolle Robotik umfassen:

- Menschenzentriertheit: Robotertechnologie sollte menschliche Fähigkeiten ergänzen und erweitern, nicht ersetzen.

- Transparenz: Die Funktionsweise und Entscheidungsfindung von Robotern sollte nachvollziehbar sein.

- Verantwortlichkeit: Klare Zuordnung von Verantwortung für Roboterhandlungen.

- Gerechtigkeit: Faire Verteilung der Vorteile und Risiken der Robotertechnologie.

- Privatheit: Respekt für Privatsphäre und persönliche Autonomie.

- Sicherheit: Schutz vor physischen und psychologischen Schäden.

Die Gestaltung der Zukunft der Robotik ist nicht nur eine technische, sondern auch eine gesellschaftliche Aufgabe. Sie erfordert einen breiten Dialog zwischen verschiedenen Disziplinen und Interessengruppen. Nur so können wir sicherstellen, dass diese transformative Technologie zum Wohle aller eingesetzt wird und im Einklang mit unseren ethischen Werten steht.

Als Gesellschaft stehen wir vor der Herausforderung, einen Weg zu finden, der technologischen Fortschritt ermöglicht, ohne unsere ethischen Grundwerte zu opfern. Die Art und Weise, wie wir diese Herausforderung meistern, wird maßgeblich die Zukunft prägen, die wir mit unseren robotischen Schöpfungen teilen werden.